Adelantarse a una crisis: habilidades de detección de deepfakes + acceso global a herramientas forenses para multimedia

Este blog fue escrito originalmente en inglés por Sam Gregory el 14 de julio de 2021.

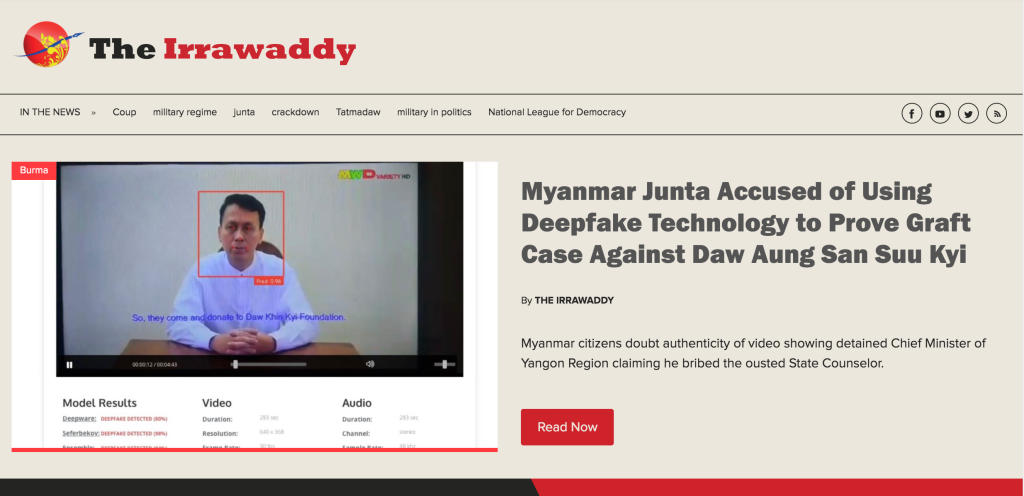

En un artículo de opinión de WIRED, compartí la historia del reciente pánico causado por un deepfake en Myanmar. Spoiler: Probablemente no fue un deepfake … pero tiene implicaciones importantes sobre cómo pensamos acerca del acceso a la tecnología de detección de deepfake y qué habilidades, capacidades y opciones de escalamiento son necesarias. Puedes leer más sobre la historia aquí.

“RECIENTEMENTE, el gobierno militar golpista en Myanmar agregó serias acusaciones de corrupción a una serie de casos espurios existentes contra la líder birmana Aung San Suu Kyi. Estos nuevos cargos se basan en las declaraciones de un destacado político detenido que se publicaron por primera vez en un video de marzo que muchos en Myanmar sospechaban que eran falsos, un deep fake.

En el video, la voz y el rostro del prisionero político parecen distorsionados y antinaturales mientras hace una afirmación detallada sobre haber entregado oro y dinero en efectivo a Aung San Suu Kyi. Las personas usuarias de redes sociales y periodistas en Myanmar cuestionaron inmediatamente si la declaración era real. Este incidente ilustra un problema que solo empeorará. A medida que mejora la calidad de los videos que sí son deepfakes, también aumentará la disposición de las personas a descartar material real como un deepfake. ¿Qué herramientas y habilidades estarán disponibles para investigar ambos tipos de casos y quién las utilizará? “.

Durante los últimos tres años, WITNESS ha liderado el enfoque “Prepárate, que no cunda el pánico” con los deepfakes y las nuevas formas de manipulación de medios sintéticos. Un área clave que hemos explorado es el acceso a herramientas de detección de deepfakes acompañado de la experiencia y los recursos necesarios para usarlas. Una dimensión crítica es la equidad en el acceso tanto a las herramientas de detección de deepfakes como a la capacidad de usarlas, y cómo esto se logrará globalmente para quienes más lo necesitan.

En esta publicación de blog, resumo las recomendaciones y los aprendizajes de nuestro trabajo centrado en facilitar las herramientas adecuadas, el acceso y el soporte relacionado para la detección de deepfakes. Lo anterior incluyó una fase de evaluación de necesidades y una consulta comunitaria profunda con personas que habían enfrentado experiencias y expertxs relevantes para el tema en 2019-20, y luego actividades de investigación y consulta en 2020-21 por Partnership on AI y WITNESS explorando cómo facilitar el acceso y dar apoyo.

¿Ahora que? Recomendaciones

En el futuro, es urgente que la comunidad de investigación de deepfakes, una comunidad forense de medios más amplia y quienes financian tecnología, la sociedad civil, la desinformación y el periodismo aborden estas áreas.

- La equidad en el acceso a las habilidades y la capacidad de detección de deepfakes es fundamental. Necesitamos el compromiso de financiadores, personas que capacitan a periodistas y las plataformas de redes sociales para profundizar la capacidad y la experiencia en el uso de herramientas forenses de detección de personas periodistas, defensoras de derechos y otras personas a nivel mundial que están en la primera línea de la protección de la verdad y desafiar las mentiras.

- Necesitamos desarrollar una capacidad de expertx forense de multimedia. Esto debería estar disponible para evaluar los casos de alto interés público de deepfakes, incluidos los casos en que sí se trata de un deepfakes y los casos en los que se está utilizando el “dividendo del mentiroso” para afirmar que las imágenes reales son falsas. Como en el caso de Myanmar, la escalada rápida de una acusación de corrupción impugnada contra una persona destacada en la política es exactamente el tipo de caso en el que esto estaría justificado. Como siguiente paso, debemos convocar a las grupos clave en el periodismo, la ciencia forense de multimedia y la academia para evaluar los modelos potenciales para el acceso a una experiencia más profunda y para la escalada de casos de manipulación de los medios particularmente desafiantes fuera de los contextos forenses de los medios tradicionales y de aplicación de la ley. Aviv Ovadya ha propuesto un modelo para un Consejo Internacional de Autenticidad de los Medios, y WITNESS planea resaltar una variedad de enfoques para la escalada.

- Según lo identificado por la Partnership on IA, necesitamos desarrollar un conjunto sólido de principios y luego implementar un protocolo de gobernanza para el acceso a herramientas de detección de deepfakes que, al establecer expectativas sobre quién tiene acceso a qué herramientas, lo haga con atención a las necesidades y dinámicas globales y la urgencia de brindar acceso en todo el mundo a periodistas clave, sociedad civil y personas que combaten la desinformación a nivel comunitario.

- Dentro de las herramientas de detección de deepfakes y un protocolo de gobernanza, debemos identificar formas de respaldar el acceso abierto y las herramientas no comerciales y conciliar esto con la naturaleza contradictoria de la detección y la síntesis.

- Necesitamos empresas e investigadorxs que inviertan en síntesis de medios para comprometerse a compartir recursos con los esfuerzos de detección, incluido el suministro de información comercialmente viable y el input sobre propiedad intelectual específica sobre sus propias técnicas que ayudarán a respaldar los esfuerzos de detección. Esta necesidad puede formar parte de códigos de conducta emergentes en este espacio, incluidos aquellos en los que participa WITNESS.

¿Cómo logramos una mayor equidad global en el acceso a la detección ?: Contexto de los Encuentros de 2019-20

Una suposición clave en el trabajo de WITNESS es que muchas personas están ansiosas por “resolver” nuevas formas de manipulación de los medios. Pero para hacerlo bien, tenemos que escuchar a la gama adecuada de personas a nivel mundial con experiencia vivida y experta. Hemos organizado encuentros con personas en los EE.UU., Brasil, África subsahariana y sur/sureste de Asia que lo han vivido como experiencia propia y personas expertas en problemas relacionados con la desinformación, violencia basada en género; hemos conectado con periodistas, empresas e investigadorxs, y hemos promovido las políticas adecuadas, así como la tecnología con acceso y nuevos enfoques para rastrear la confianza (tracking trust), como la autenticidad y la infraestructura de procedencia.

Un área clave que discutimos en nuestras reuniones fue cómo funciona la detección de deepfakes y cómo aseguramos la equidad global en el acceso a herramientas y habilidades. Las personas participantes preguntaron:

En primer lugar, ¿cómo responden las soluciones de detección a las necesidades fuera de los centros de poder en términos de la relevancia de sus enfoques?

En segundo lugar, en un mundo donde el acceso a estas herramientas vendría a cambio de una mejor utilidad y eficacia de las herramientas de detección, debemos considerar realmente la equidad en la detección. ¿Cómo se proporciona el acceso de manera equitativa y se evita la perpetuación de las desigualdades sistémicas?

Las observaciones clave de los informes de estas reuniones globales se capturan a continuación y se describen con más detalle en el blog “¿Qué se necesita en la detección de deepfakes?”.

Reflexiones clave del encuentro en Sur y Sureste de Asia:

-

- Ofrecer accesibilidad a sistemas de detección

- Construir capacidades forenses de multimedia

- Una base de datos de personas expertas que puedan apoyar a periodistas en la identificación de medios sintéticos

- Priorizar las herramientas correctas para los multimedia usados fuera de contexto y shallowfakes

- Identificar mecanismos para manejar la difusión sin consentimiento de imágenes sexuales

Reflexiones clave del encuentro con personas expertas de Brasil:

“Una gran parte de la accesibilidad es tener mejores herramientas forenses para el multimedia que sean de bajo costo y estén a la disposición de todas las personas, pero esto debe ser combinado con capacidad periodística en nuevas formas de verificación y conocimientos forenses multimedia”.

Reflexiones clave del encuentro con personas expertas de África Subsahariana:

“Después de ver una amplia gama de técnicas de detección avanzada disponible para investigadorxs de ciencias computacionales, hubo preocupaciones sobre el tiempo que tardarían estas técnicas en estar disponibles para grupos indígenas, comunidades de base, o incluso para medios de comunicación, y que no se llevaran a cabo esfuerzos para construir puentes entre la sofisticación técnica necesaria para implementar e interpretar las técnicas.”

Reflexiones clave del encuentro con personas expertas de África Subsahariana:

“Personas profesionales de los medios enfatizan la necesidad de más colaboración y compartir de recursos para poder responder a esta amenaza efectivamente y con un uso eficiente de fondos limitados. Periodistas y verificadorxs identificaron campos de especialización técnica muy avanzada por ejemplo la forense de medios, como un área donde los recursos pueden compartirse entre equipos y organizaciones.”

Los antecedentes de estas preocupaciones se pueden resumir en estos términos, que han sido corroborados en otros encuentros e investigaciones de WITNESS y en otros esfuerzos de Partnership on AI y sus equipos de debate sobre medios sintéticos y medios manipulados.

- Relevante: ¿Qué relevancia tienen los enfoques de detección para los problemas del mundo real?

- Disponible: ¿Qué tan disponibles y accesibles son los enfoques de detección para las personas usuarias finales?

- Útil: ¿Cuán interpretables, explicables y útiles son los resultados de una detección?

- Complementario: ¿Las herramientas que se están desarrollando con la integración de la alfabetización mediática y la comprensión del usuarix contradicen la “evidencia de ojos” en mente?

- Capacidad: ¿Las herramientas se están acompañando con la construcción de capacidades?

También escuchamos alto y claro que lxs participantes esperaban más atención a los problemas actuales. Querían que las plataformas, tecnólogxs e investigadorxs abordaran los problemas existentes, como las falsificaciones superficiales como multimedia fuera de contexto y los shallowfakes ligeramente editados, por ejemplo, con una mejor búsqueda inversa de video y el seguimiento de los contenidos falsos existentes en todas las plataformas.

También existe una preocupación fundamental por el dividendo del mentiroso y sus implicaciones para socavar la confianza en los videos y las imágenes, particularmente en el contenido de personas como periodistas ciudadanxs, y de cómo ejerció presión adicional sobre periodistas, verificadorxs de hechos y buscadorxs de la verdad para contrarrestar las exhaustivas afirmaciones de falsificación y demostrar la verdad (no solo demostrar la falsedad).

Identificar enfoques para la detección de equidad, acceso y apoyo en construcción de habilidades: retroalimentación de 2021

A principios de 2021, WITNESS se asoció con Partnership on AI para realizar grupos focales con preguntas sobre la equidad de detección y acceso. Estos involucraron a un subconjunto de periodistas, activistas, verificadorxs, especialistas en desinformación y líderes comunitarios que habían participado en reuniones previas de WITNESS para Brasil y África subsahariana.

Enmarcamos nuestra discusión en términos del dilema de detección de deepfakes identificado en el reciente artículo de Partnership on AI que fue revisado por pares y presentado en la conferencia ACM AIES de este año.

El Dilema de Detección de Deepfakes plantea que al comenzar a desarrollarse herramientas para detectar deepfakes y otros medios sintéticos, organizaciones de la sociedad civil y periodistas no tienen el acceso que tienen las plataformas y lxs investigadores. Sin embargo, el acceso amplio a esta tecnología puede hacerla menos efectiva porque también proporcionaría a los adversarios información importante. En estas circunstancias, ¿cómo se puede facilitar el acceso y el apoyo de manera equitativa, amplia y para poblaciones diversas?

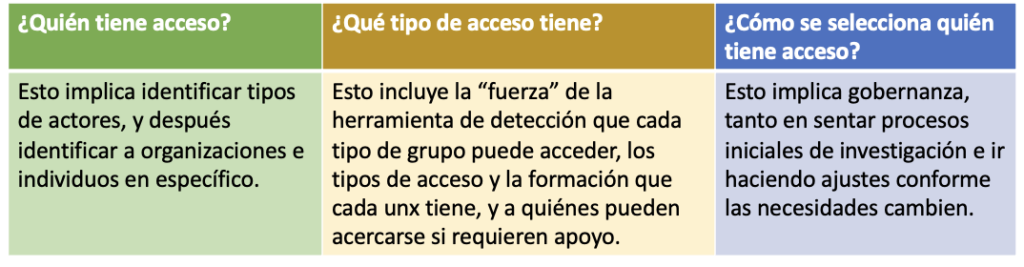

Estas tres preguntas formaron el núcleo de nuestra discusión dentro de grupos focales de 12 a 15 participantes extraídos de medios de comunicación, iniciativas de verificación, activismo comunitario y defensa de los derechos humanos, y esfuerzos contra la desinformación.

Esto es lo que escuchamos…

Conclusión: ¿Quién tiene acceso a las herramientas de detección de deepfakes?

- Garantizar el apoyo para a) periodistas y verificadorxs que necesitan estas herramientas en su trabajo diario, b) líderes de confianza en las sociedades, así como brindar apoyo para c) organizaciones comunitarias y médicxs de desinformación a nivel comunitario que enfrentan amenazas y ataques continuos

- Identificar intermediarios y opciones de escalamiento adecuados al contexto, por ejemplo: entidades de la industria como la Red Internacional de Verificación de Datos (IFCN), la Red Brasileña de Periodismo de Investigación Abraji en Brasil o redes como First Draft y WITNESS

- Garantizar que las soluciones de código abierto y de acceso abierto estén ampliamente disponibles, así como opciones no comerciales.

- Tanto las herramientas de acceso restringido como las de acceso abierto deben ir acompañadas de habilidades de interpretación y alfabetización mediática relevantes.

Conclusión: ¿Qué acceso se debe proporcionar y cómo? Debe ser controlado y abierto, teniendo en cuenta la exclusión y los intermediarios inadecuados.

- Si bien el supuesto de acceso predeterminado que presentaron WITNESS y PAI, y al que muchos participantes se inclinaron, se centró en el acceso controlado a un mecanismo de detección a través de una organización intermediaria, también deben existir opciones de acceso abierto, en particular para brindar acceso a los grupos más vulnerables y con menos recursos.

- Los llamados sobre el acceso abierto son legítimos ya que se relacionan con preocupaciones sobre la exclusión al nivel comunitario y para lxs más vulnerables y sobre el dominio de las herramientas comerciales, así como las profundas preocupaciones globales sobre el apoyo al software libre (y de código abierto) y al acceso abierto.

- Los llamados sobre el acceso abierto, así como la cautela sobre los mecanismos intermediarios, también reflejaron cautela sobre las suposiciones ingenuas sobre los intermediarios y las opciones de escalamiento (por ejemplo, asumir que las empresas de medios dominantes en países particulares son confiables, o no comprender los vínculos con el gobierno y el poder comercial). Una pregunta fundamental en cualquier contexto es ¿quiénes son los intermediarios de confianza social?

Conclusión: Profundizar y diversificar el acceso a los conocimientos y la capacitación, y crear mecanismos para escalar

- Sin capacitación para comprender los resultados y el análisis forense de medios más amplio, el acceso a las herramientas no tiene mucho valor.

- Lxs intermediarixs que apoyan a otrxs necesitarán una formación más profunda.

- ¿Cuáles son los mecanismos de escalada y a quién escalarían? Habrá una necesidad de tener mecanismos de escalada a expertxs calificadxs con capacidad forense en medios que puedan responder a los casos más difíciles de forma rápida, racionalizada y creíble.

Muchas de estas consideraciones se reforzaron en el caso de Myanmar que se menciona al inicio de este blog. En ese caso, lxs detectives aficionadxs y comentaristas en línea intentaron probar el video sospechoso en un detector de deepfakes en línea y regresaron con un resultado positivo de más del 90% de certeza que indica una falsificación. Sin embargo, carecían de conocimiento sobre cómo funcionan las herramientas de detección de deepfakes y bajo qué circunstancias. No consultaron recursos ni a expertos para corroborar sus hallazgos.

Las conclusiones clave de ese caso reciente del mundo real refuerzan las preocupaciones de lxs participantes en nuestras reuniones:

- La detección debe ser relevante, disponible, accesible, útil, complementaria a la comprensión del usuarix y estar emparejada con las capacidades y las habilidades

- Las herramientas de acceso abierto sin apoyo o contextualización de cómo usarlas son más peligrosas que útiles

- Una comprensión pública limitada de los deepfakes, incluida la forma en que se sintetizan y el cómo se detectan perpetúa la incomprensión de los resultados de detección

- La falta de habilidades periodísticas y mediáticas en el análisis forense de los medios o en la evaluación de la manipulación de los medios dificulta que lxs periodistas ayuden a discernir si algo es falso

- La sociedad civil y lxs periodistas no tienen forma de acercarse rápidamente para involucrar a personas expertxs

- No hay capacidad de escalada para el análisis forense de medios complejos

- Todo esto tiene lugar en el contexto del “dividendo del mentiroso”, que aumenta la capacidad de afirmar que algo es un deepfake y obligar a otrxs a demostrar que es cierto.